Possiamo ancora prenderci del tempo per contemplare il movimento e la trasformazione di una falena? Questo animale notturno, delicato e destinato a essere per molti il cugino schifoso della farfalla, è in realtà l’oggetto della metafora che Georges Didi-Huberman, filosofo e storico dell’arte, utilizza nel suo saggio L’immagine brucia. Nell’opera, l’autore tenta di delineare poeticamente i diversi atteggiamenti delle persone di fronte alle immagini, dando facoltà di scelta a chi guarda, di essere o un collezionista-cacciatore, che cattura e soffoca la falena nell’etere per osservarne i più piccoli dettagli, o un sognatore emozionato che segue l’animale, accetta di vederne solo un aspetto discontinuo e lo segue fino a quando non scompare.

In Medium Hot. Intelligenza artificiale e immagini ai tempi del riscaldamento globale, raccolta di saggi della regista e ricercatrice – e attivista – Hito Steyerl questa domanda si trasforma in: “ci è ancora concesso del tempo per contemplare il movimento e la trasformazione della falena?”, ma soprattutto “ci interessa di più che questa falena sia viva o stecchita, o se sia o meno reale? E quali danni può creare alla fauna e alla flora circostanti una falena artificiale?”. La metafora di Didi-Huberman, a distanza di anni, è ancora più che attuale e si evolve nello sviluppo del nostro rapporto con le immagini. I saggi di Medium Hot ruotano attorno a una serie di dicotomie che hanno come fulcro il binarismo tra movimento e stagnazione. Attorno a questo perno, si sviluppano le categorie di presente e futuro, storia e sospensione, omogeneità e differenza, entropia e stasi. Ogni saggio merita un commento a parte, per cui è inutile che cerchiate un resoconto limpido e calcolato del contenuto in toto di quest’opera. Non lo avrete da questo pezzo.

Piuttosto, nel desolante e calcolato panorama descritto da Steyerl in questa serie di contributi, in cui le stesse teorie di Marshall McLuhan vorrebbero fare da appiglio concettuale, ma scivolano rovinosamente nel settore dell’obsoleto (hot non si riferisce alla contrapposizione tra media caldi e freddi, ma al contributo della tecnologia che alimenta i server del mondo al surriscaldamento globale), due sono i saggi che hanno colpito particolarmente la mia attenzione e affrontano, in larga parte, il discorso tra passato e futuro, attraversando mimeticamente il presente, quasi sperando che i fenomeni contenuti passino inosservati. Knuckleporn o focomelia e La frattura digitale sono legati dalla questione del vedere, che non riguarda solo lo sguardo umano – non più – ma quello che, antropizzandola, associamo alla macchina che produce immagini, in particolare l’IA generativa. Nel primo saggio, l’autrice si chiede per quale motivo i generatori di immagini non riescano a riprodurre fedelmente l’anatomia umana, associando il loro meccanismo di ri-produzione a quello dell’arte medievale che crea chimere in luogo di entità mai viste, accorpando pezzi di esseri viventi che conosce. La domanda che si pone, principalmente, è la seguente: in che modo questi sistemi vedono gli esseri umani? La scoperta sconcertante, per certi versi, è che macchine create dall’uomo possano aver necessità di allenarsi a vedere come vedrebbe un apprendista umano in un atelier d’arte: la prima cosa da fare quando si impara a disegnare un corpo è realizzare studi di nudo. Così, la macchina deve addestrarsi su immagini che portano con sé il rischio, non necessariamente calcolato, che all’interno di questi esempi di anatomia umana rientrino immagini illegali legate alla pedopornografia. Il secondo saggio, La frattura digitale, recupera uno scritto di Steyerl del 2009, In defense of the poor image, per mostrare come la situazione, dopo più di quindici anni, sia radicalmente ribaltata a favore di un’immagine potente/carica, che la studiosa chiama power image. Tali immagini, lungi dall’aspetto di ampia circolazione che caratterizzava le poor images, fenomeno “ambivalente, che consentiva alle persone di creare collegamenti a patto che si sottoponessero alle condizioni del capitalismo comunicativo”, agglomerano ed estraggono dati, in una funzione attiva che ricorda molto il titolo di una raccolta di saggi dello storico dell’arte Horst Bredekamp, Immagini che ci guardano e che potrebbe essere perfezionato in Immagini che ci guardano, per tenerci a bada in un’area nebulosamente mediana. Il fulcro di questo saggio è il binarismo power-poor (che non voglio tradurre in italiano perché entrambi i lemmi contengono i plurimi e coerenti significati di potere, potenza, carica da un lato, e povero, privo di risorse e vuoto dall’altro) che sottintende un altro aspetto ambivalente che è contenuto all’interno del concetto di statistica usato dall’autrice.

Per riprendere la metafora della combustione di Didi-Huberman, relativa alla fruizione dell’immagine, Steyerl introduce nel primo saggio della raccolta la nozione di statistica che “individua il comune e ignora il particolare” offrendo dati per previsioni future a partire da una versione quantificata del passato. In particolare, il campo dell’arte è diventato il palcoscenico perfetto per parlare di intelligenza artificiale, nonostante “nemmeno le stesse aziende sapevano di preciso a cosa potesse servire un’IA general-purpose”. Le immagini che vediamo sembrano, a Steyerl, sempre le stesse, inserite all’interno di una “poltiglia visiva statica” in quanto, nota, le culture digitali orbitano intorno alla medianità: per questo l’utilizzo della statistica è importante. Per creare un’immagine soddisfacente, a partire dal prelievo, la riduzione a sistema vettoriale e la ricombinazione in modo ottimizzato di varie fonti in una nuova immagine, Steyerl sottolinea la necessità di una grande quantità di dati – dal passato – che creano la possibilità di una previsione – l’immagine futura – attraverso la ricombinazione di elementi, per l’appunto, individuando il comune e ignorando il particolare.

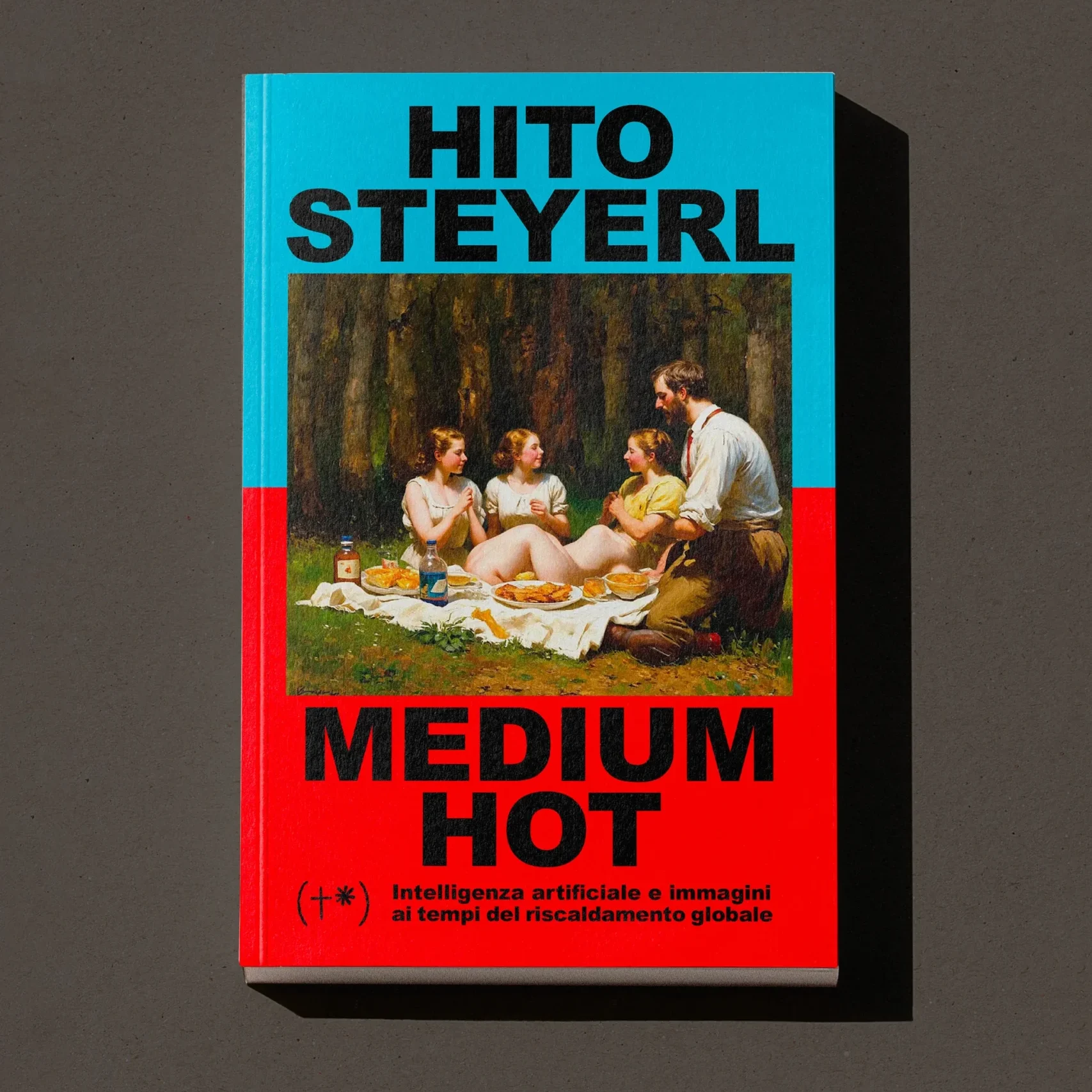

È questo il tema che ha portato, in Knuckleporn e focomelia, a svariati problemi relativi alle modalità con cui nutrire la macchina di informazioni per realizzare i corpi umani. I generatori di immagini basati sull’IA non pongono, ormai, solo problemi di natura tecnica, ma “dilemmi sociali e persino morali, o, per essere più precisi, questioni di (mancata) responsabilità, attribuzione di colpa e censura.” Questo severo giudizio dato dall’autrice sulla gestione della rappresentazione umana non solo ribalta l’idea illuminista che l’IA generativa sia al servizio di una rappresentazione standardizzata e appagante in stile neo-rinascimentale, ma solleva la questione della responsabilità su aziende come Stable Diffusion 3 o Stability AI che da una parte contenevano una miniera di dati pedopornografici per l’addestramento della macchina alla produzione di anatomie umane e dall’altro, per evitare tali ripercussioni sulla sfera morale (ed economica) del progetto, ipercorreggevano il dataset di addestramento, escludendone qualsiasi elemento considerato pornografico. Non è tanto lontano da ciò che succede, tutt’ora ma in misura meno eclatante a livello mediatico rispetto a qualche anno fa, con le immagini di opere d’arte rappresentanti nudo caricate sui vari social: l’esposizione di un seno, un pene o una vagina hanno portato all’oscuramento di molti profili, soprattutto quelli legati alla divulgazione culturale o alla promozione della propria attività artistica. La copertina di Medium Hot racconta di questa esperienza di addestramento e ipercorrettivismo in modo esplicito: la macchina sembra essere “riluttante” ad affrontare tette, mani, piedi, dimostrando, addirittura, che alcuni sistemi non riescono a distinguere fra corpi umani e cibo: quale falena sta osservando in questo momento la macchina? In che modo la osserva? È una cacciatrice-collezionista oppure una sognatrice emotiva che si accontenta di alcuni movimenti discontinui? Secondo il tecnologo e giornalista James Bridle queste immagini sono il frutto delle “regole figurative e delle norme legali e morali imposte dalle/alle industrie digitali” che creano distorsioni e mutilazioni corporee pur di non incappare nell’accusa di creare pornografia illegale.

Se questa immagine generata attraverso prompt è frutto di una caccia sfrenata al giusto gusto medio, si perde l’essenziale, la possibilità indicata da Didi-Huberman come il ritorno dell’immagine, nella continuazione della metafora della falena, che riappare non appena accendiamo una candela. La falena, attratta dal fuoco della candela, si avvicinerà talmente tanto che finirà per bruciare e di lei non rimarrà che cenere. Questo rischio è quanto si chiede di evitare alla generazione di immagini tramite IA generativa, prendendo, manipolando e ripresentando le stesse tipologie figurative senza riferirsi alla verità “bensì alla probabilità” in quanto rendering statistici, “versioni della media calcolata a partire da un enorme saccheggio online di dati pescati a strascico.” Steyerl su questo è lapidaria: tali immagini “rimpiazzano le sembianze con le verosimiglianze. Saranno anche ‘immagini povere’ in termini di risoluzione, ma nello stile e nella sostanza sono: mean images – immagini di medie, immagini mediocri e immagini meschine”. Niente deve bruciarsi, tutto deve rimanere intatto al fine di creare un archivio utopistico di dati che possano essere rimaneggiati a seconda della percezione sociale media di quello che si chiede di rappresentare. Steyerl afferma che lei stessa è presente in questa equazione e, quando richiesto a Stable Diffusion di rappresentarne un ritratto, la macchina presenta una donna “in uno stato di raggelata rabbia senile [secondo] un algoritmo a scatola bianca, o filtro sociale”. Il modo in cui Stable Diffusion riproduce il ritratto di Hito Steyerl è direttamente proporzionale al segnale sociale, costruendo un ritratto “su medie correlate”. La sua immagine (una mean image) diventa un prodotto prevedibile, che si rifà, ancora una volta, alla statistica, residua e mediocre. Queste immagini sfruttano il lato dell’emozione sociale, quello di chi non cattura ma insegue la falena e si accontenta del suo movimento discontinuo, senza avere la minima idea di cosa sia un’emozione o a cosa serva, “sogni sociali senza sonno” che fanno da specchio alla società. Eppure, come precisa Didi. Huberman all’inizio del suo saggio, “se il fuoco lo consuma, è vero”, al contrario: se l’immagine non va in cenere, non è reale.

L’archivio che si vuole ricreare, infatti, è utopistico in quanto vorrebbe contenere al suo interno una totalità di dati tale che non siano presenti lacune; nonostante questo, “è scoprendo la memoria del fuoco in ogni foglio che non è bruciato che facciamo l’esperienza di una barbarie documentata in ogni documento della civiltà”, ovvero: la cenere che si tenta di evitare è il segno stesso di tutto quello che prima era presente e che adesso è bruciato, perché l’archivio non deve essere identificato come i fatti e i gesti, ma come il luogo che ne offre solo alcune vestigia, tempestate da lacune. Probabilmente è per questo che, nella Frattura digitale, Steyerl si occupa della ripetizione e della conseguente stasi della cultura, in un momento storico in cui si dovrebbe sentire la necessità di agire attivamente di fronte a guerre e crisi umanitarie. È una domanda esplicita, la sua: com’è che la cultura sembra inerte? L’unico elemento che sfugge a questa inerzia, impiegando grandi quantità di energia, è il processo di addestramento e calcolo richiesto per la generazione di immagini mediane. Le power images sono tali in quanto richiedono un enorme dispendio di energia, con conseguenze disastrose per l’ambiente poiché generano “un’impronta di carbonio, inquinamento, spreco e sfruttamento di risorse” naturali e umane che estraniano l’uomo in un panorama culturale stagnante, rispetto alle condizioni naturali della sua esistenza. Per esplicitare questo enorme disagio culturale Steyerl propone il termine “frattura metabolica”, un concetto marxista che applica alla produzione di immagini: quando l’essere umano è alienato dalle proprie condizioni naturali, si verifica quello straniamento che è stato prodotto dalla società capitalistica e che, nel caso delle immagini prodotte digitalmente, è traslato sul piano dell’artificialità. Lo scarto umano, rappresentato in natura dagli escrementi utili per la concimazione dei campi, diventa l’accumulo di dati umani nel traffico online che intossica il clima intellettuale e politico fino all’esaurimento e al burnout, in quanto non utile alla fertilizzazione del pensiero. Questi dati, simili tra loro, sempre uguali a se stessi, assuefanno l’essere umano all’omogeneità culturale, rendendo la differenza un pericolo e portando a una inerzia di massa.

I dati non smaltiti, quelli che in un processo naturale sarebbero dovuti diventare in parte cenere – anch’essa un fertilizzante naturale – creano una stagnazione del sistema e vincono sulle tracce significative, quelle che in un archivio sano sarebbero le isole in mezzo alle lacune bucherellate. L’anacronismo e l’eterogeneità non sono più contemplati, non esiste il rischio di “immaginazione e montaggio” che tenta, a partire dai pezzi sopravvissuti all’incendio, di ricostruire un elemento o un fatto. Avendo una quantità infinita di dati, non è possibile orientarsi “nel pensiero della storia” perché si è troppo impegnati a consumare energia per appiattire e smaltire la mole. Questa serie di azioni non è un processo metaforico: la domanda di energia per alimentare i vari server è altissima e in molti paesi supera di gran lunga le scorte energetiche portando con sé conseguenze estremamente gravi per quanto riguarda la transizione energetica e gli obiettivi di transizione ecologica in cui sono coinvolte aziende e nazioni. Qual è il motivo principale di tutta questa fretta nella corsa alla creazione di una “superintelligenza” secondo le ricerche di Steyerl? Arrivare per primi, con ogni mezzo, “anche a costo di bruciare più energia fossile.” A quel punto non è più necessario costruire un archivio per la “banalità” della conservazione della memoria, ma per incanalare un flusso di possibilità che, al momento giusto, possono essere montate insieme – la chimera degli inizi – per creare qualcosa che si pensa possa esistere “in natura”, in uno spazio che non è abitato dalla macchina e di cui può solo azzardare probabilità.

Si potrebbe pensare che questo processo si avvicini similmente all’idea di montaggio tipica dei film: sopravvivenze, anacronismi, contraddittorietà sono tutti aspetti possibili dell’accostamento di brandelli di materiale archiviato. Ma a cosa serve questo linguaggio se non è presente una concezione di memoria intesa come “memoria inconscia, quella che non si lascia tanto raccontare quanto interpretare nei suoi sintomi”? Serve a rendersi conto che l’immagine non è né immediata, né facile da capire, che la sua forza è nell’essere contemporaneamente sintomo (incrinatura dei segni, interruzione del sapere) per Didi-Huberman, e conoscenza (interruzione del caos). Il problema, inteso come limite, dell’omogeneità, del riscaldamento del medium che tutto porta sullo stesso piano di medianità e mediocrità e che non brucia come sintomo della crisi, sta nel ruolo che viene riassegnato all’immagine creata dal nuovo sistema di assimilazione, l’IA generativa: un elemento separato dalla storia e dalla memoria, a cui è impedito da un lato di “rendere visibile la tragedia nella cultura” e dall’altro di rendere visibile “la cultura nella tragedia”. Per fare questo, occorre avere davanti un’immagine che ci chiede di sospendere per un attimo il tempo, lasciandoci disorientati: questo non è possibile se la generazione dell’immagine si basa sul prevedibile, non crea un’esperienza, ma un “già visto, già vissuto” che si trasforma direttamente in linguaggio, ovvero in cliché che soffoca l’immagine per moltiplicazione.